Claude Prompt Generator: Narzędzia i Metaprompting 2026

Spis treści

- Mechanika Metapromptingu: Jak działa generator promptów dla Claude?

- Przegląd i porównanie narzędzi typu Claude Prompt Generator w 2026 roku

- Architektura System Prompts i składnia XML w generowanych instrukcjach

- Automatyzacja inżynierii promptów: Budowa własnego generatora dla Claude w Pythonie

- Implementacja branżowa: Szablony i dobór modelu do wygenerowanego promptu

- Podsumowanie: Kiedy claude prompt generator to za mało?

Mechanika Metapromptingu: Jak działa generator promptów dla Claude?

Generator promptów dla Claude to nie jest prosty szablon do uzupełniania. To wyspecjalizowane narzędzie inżynieryjne, które tłumaczy Twoją intencję na język zrozumiały dla architektury modeli Anthropic. Jego działanie opiera się na fundamentalnej zasadzie: aby uzyskać precyzyjne wyniki, musisz dostarczyć precyzyjne, ustrukturyzowane instrukcje. Generator automatyzuje ten proces, oszczędzając czas i zasoby obliczeniowe.

Metaprompting: Jak wykorzystać Claude do generowania idealnych instrukcji dla samego siebie

Metaprompting to technika, w której wykorzystujesz model językowy do stworzenia lub udoskonalenia promptu dla tego samego lub innego modelu. Zamiast ręcznie iterować nad idealną instrukcją, zlecasz to zadanie samemu Claude. W praktyce, proces ten polega na dostarczeniu modelowi (zazwyczaj najpotężniejszemu, jak Claude 3 Opus) meta-promptu. Taki meta-prompt zawiera opis zadania, specyfikację pożądanego formatu wyjściowego, przykłady (few-shot prompting) oraz wytyczne dotyczące tonu i stylu.

Model, przetwarzając ten ogólny zarys, generuje finalny, wysoce zoptymalizowany prompt. Zawiera on już precyzyjną strukturę, często opartą na tagach XML, oraz szczegółowe polecenia. Kluczowym elementem tego procesu jest translacja Twojej mglistej intencji na precyzyjny łańcuch myślowy (Chain of Thought). Generator dekonstruuje cel, np. "przeanalizuj raport", na serię logicznych, sekwencyjnych kroków, które Claude ma wykonać. Zamiast generycznego polecenia, powstaje skrypt operacyjny: <step_1>Zidentyfikuj kluczowe wskaźniki KPI w załączonym dokumencie.</step_1><step_2>Porównaj te wskaźniki z danymi historycznymi z drugiego pliku.</step_2><step_3>Sformułuj wnioski i rekomendacje w formacie Markdown.</step_3>.

To podejście jest tak skuteczne, że nawet sami twórcy modelu je rekomendują. W oficjalnej dokumentacji Anthropic znajdziesz narzędzie, które działa właśnie w ten sposób, co potwierdza, że oficjalny generator Claude jest w istocie zaawansowaną implementacją metapromptingu.

Kluczowe różnice w tworzeniu promptów dla Claude i ChatGPT

Chociaż oba modele należą do czołówki LLM, ich architektury wymagają odmiennego podejścia do inżynierii promptów. Ignorowanie tych różnic prowadzi do frustracji i wyników poniżej potencjału, zwłaszcza w przypadku Claude.

Po pierwsze, Claude preferuje długi, ustrukturyzowany kontekst zamiast krótkich, konwersacyjnych komend. Tam, gdzie w ChatGPT wystarczy polecenie "Napisz post na LinkedIn o AI na podstawie tego tekstu: [tekst]", Claude osiąga szczytową wydajność, gdy otrzyma prompt opakowany w tagi XML. Dobry generator stworzy strukturę: <instruction>Napisz post na LinkedIn o AI, bazując na poniższym artykule. Skup się na trzech kluczowych wnioskach.</instruction><article_content>[tekst]</article_content>. Taka separacja pozwala modelowi precyzyjnie odróżnić polecenia od danych wejściowych, co jest kluczowe dla uzyskania powtarzalnych i dokładnych rezultatów.

Po drugie, rola 'Constitutional AI' jest nie do przecenienia. Claude jest trenowany w oparciu o zbiór zasad (konstytucję), które promują pomocność i bezpieczeństwo. Generator musi tworzyć prompty, które są zgodne z tymi zasadami. Instrukcje, które mogą być zinterpretowane jako manipulacyjne lub prowadzące do generowania treści na granicy wytycznych, zostaną przez model "skorygowane" w stronę bezpieczniejszej, bardziej neutralnej odpowiedzi. Dobry generator wie, jak formułować polecenia w sposób autorytatywny i jednoznaczny, aby uniknąć tego mechanizmu i uzyskać zamierzony efekt.

Wreszcie, ogromne okno kontekstowe modeli Claude (sięgające setek tysięcy tokenów) to miecz obosieczny. Daje ogromne możliwości analizy złożonych dokumentów, ale jednocześnie wzmacnia każdy błąd wynikający z niejednoznaczności. Dwuznaczne polecenie w promptcie na 100 000 tokenów może spowodować, że model zgubi główny wątek. Generatory wymuszają precyzję językową, eliminując semantyczne pułapki i zapewniając, że instrukcja jest jednoznaczna na całej długości kontekstu. Zrozumienie tych mechanizmów to fundament, a pełną analizę, w tym szczegółowy ranking narzędzi, meta-prompting i techniki optymalizacji, znajdziesz w naszym głównym opracowaniu na ten temat.

Przegląd i porównanie narzędzi typu Claude Prompt Generator w 2026 roku

Rynek narzędzi do inżynierii promptów dla modeli Anthropic dojrzał. W 2026 roku nie pytamy już "czy", ale "którego" generatora użyć. Wybór zależy od skali projektu, poziomu zaawansowania technicznego oraz potrzeby zarządzania cyklem życia promptów. Analizujemy trzy kluczowe kategorie rozwiązań: natywne narzędzia Anthropic, komercyjne platformy SaaS oraz elastyczne frameworki open-source.

Najlepsze narzędzia i wtyczki wspierające generowanie promptów

Podstawowym punktem odniesienia pozostaje Anthropic Console Workbench. To natywna implementacja generatora, zintegrowana bezpośrednio z platformą deweloperską. Jej główną zaletą jest gwarancja wykorzystania najnowszego, najpotężniejszego modelu (zazwyczaj Opus) do procesu metapromptingu. Działa bezbłędnie, oferując solidny start i doskonałe środowisko do nauki zaawansowanych technik. Jego ograniczeniem jest brak funkcji do zarządzania biblioteką promptów na dużą skalę. To narzędzie dla jednostki, nie dla zespołu.

W odpowiedzi na te ograniczenia powstały zewnętrzne wrappery i platformy SaaS, takie jak promptgenerator.pl. Oferują one kompletne środowisko do zarządzania cyklem życia promptu: od generowania, przez wersjonowanie, testy A/B, aż po monitoring wydajności w produkcji. Kluczową funkcją tych platform jest możliwość tworzenia i współdzielenia centralnej biblioteki zoptymalizowanych promptów. Umożliwia to zachowanie spójności (np. Tone of Voice) w całej organizacji i eliminuje redundancję pracy.

Dla deweloperów i zespołów wymagających maksymalnej kontroli najlepszym wyborem są rozwiązania open-source. Frameworki takie jak LangChain czy LlamaIndex ewoluowały, oferując dedykowane moduły do pracy z Claude. Pozwalają one na pełną integrację procesu generowania promptów z istniejącymi pipeline'ami CI/CD, automatyzację testów oraz budowę niestandardowych łańcuchów (chains) z wykorzystaniem metapromptingu jako jednego z etapów. Wymaga to zasobów deweloperskich do wdrożenia i utrzymania.

| Kategoria Narzędzia | Główne Zalety | Optymalne dla |

|---|---|---|

| Anthropic Console Workbench | Bezpośrednia integracja, dostęp do najnowszych modeli, brak kosztów dodatkowych | Indywidualni deweloperzy, nauka, szybkie prototypowanie |

| Platformy SaaS | Zarządzanie biblioteką, wersjonowanie, analityka, współpraca zespołowa | Zespoły marketingowe, agencje, firmy skalujące użycie AI |

| Frameworki Open-Source | Pełna kontrola, głęboka integracja z kodem, brak opłat licencyjnych | Zespoły deweloperskie, zastosowania produkcyjne, niestandardowe workflow |

Dlaczego warto korzystać z generatorów promptów dedykowanych dla Claude?

Korzystanie z generycznych narzędzi do promptowania Claude to częsty błąd, który ogranicza potencjał modelu. Dedykowane generatory posiadają wbudowaną wiedzę o jego unikalnej architekturze.

Po pierwsze, automatyzują one implementację tagów XML. Jak wspomniano w poprzedniej sekcji, precyzyjna separacja instrukcji, kontekstu, danych wejściowych i przykładów jest kluczowa dla uzyskania powtarzalnych, wysokiej jakości wyników. Dedykowany generator automatycznie opakowuje poszczególne elementy Twojego zapytania w tagi <instruction>, <context> czy <example>, eliminując ryzyko błędu ludzkiego.

Po drugie, optymalizują one strukturę pod kątem długości kontekstu. Modele Claude z ich ogromnym oknem kontekstowym (sięgającym setek tysięcy tokenów) są podatne na problem "lost in the middle", gdzie instrukcje umieszczone w środku długiego tekstu mogą zostać zignorowane. Dedykowane narzędzia znają tę specyfikę i potrafią restrukturyzować prompt, np. powtarzając kluczowe polecenia na początku i na końcu kontekstu, aby zapewnić ich wykonanie.

Po trzecie, dramatycznie upraszczają techniki 'few-shot prompting'. Zamiast ręcznie formatować przykłady (input -> output), wystarczy je dostarczyć w prostej formie. Generator sam zadba o ich prawidłową strukturę, co pozwala na szybkie iterowanie i dostrajanie modelu do specyficznych zadań bez fine-tuningu. Szeroka dostępność sprawia, że nawet podstawowy, darmowy generator Claude potrafi zaimplementować te fundamentalne struktury, znacząco podnosząc jakość odpowiedzi.

Ostatecznie, wybór generatora to kompromis między szybkością a precyzją. Gotowe narzędzia działają na zasadzie 80/20. Dostarczają 80% optymalnej struktury i składni, oszczędzając czas. Twoim zadaniem jest dostarczenie kluczowych 20%: specyficznej wiedzy domenowej, unikalnego kontekstu i precyzyjnego zdefiniowania celu.

Architektura System Prompts i składnia XML w generowanych instrukcjach

Generator promptów dostarcza zoptymalizowaną strukturę, pełny potencjał modeli Claude odblokujesz dopiero po zrozumieniu fundamentalnych zasad ich architektury. Kluczem jest świadome wykorzystanie składni XML do hermetyzacji poszczególnych elementów zapytania. To nie jest opcjonalny dodatek, lecz rdzeń mechaniki, który pozwala modelowi precyzyjnie odróżnić, co jest poleceniem, co danymi wejściowymi, a co pożądanym wzorcem odpowiedzi. Ręczna edycja wygenerowanego szkieletu to etap, w którym 80% dobrego wyniku zamieniasz w 100% precyzji.

Jak stworzyć skuteczny System Prompt dla modeli Anthropic

System Prompt to nadrzędna instrukcja, która definiuje tożsamość, zasady i cel działania modelu w ramach całej konwersacji. To fundament, na którym opierają się wszystkie kolejne zapytania użytkownika. Skuteczny System Prompt, niezależnie czy tworzony od zera, czy na bazie wygenerowanego szablonu, musi zawierać cztery kluczowe komponenty, najlepiej ustrukturyzowane za pomocą tagów XML.

-

Rola (Persona): Zawsze rozpoczynaj od precyzyjnego zdefiniowania roli, w jaką ma wcielić się model. Zamiast "Napisz tekst", użyj:

Jesteś ekspertem ds. cyberbezpieczeństwa z 15-letnim doświadczeniem w architekturze sieci korporacyjnych.Taka specyfikacja aktywuje w modelu odpowiednie wektory wiedzy i wpływa na styl oraz terminologię. -

Zadanie i Kontekst (Task & Context): Użyj tagów XML, aby oddzielić logikę od danych. Umieść główny cel wewnątrz

<task>. Wszelkie materiały źródłowe, dokumenty, dane wejściowe czy dodatkowe informacje zamknij w tagu<context>. Ta separacja jest krytyczna. Dzięki niej model nie pomyli fragmentu analizowanego tekstu z nowym poleceniem.

Przykład:

<task>Zidentyfikuj i wypisz wszystkie potencjalne wektory ataku wymienione w poniższym raporcie. Odpowiedź przedstaw w formie listy wypunktowanej.</task>

<context>[Wklejony tutaj raport z analizy bezpieczeństwa..]</context>

-

Przykłady (Few-shot Prompting): Aby zapewnić spójność formatu i tonu, dostarcz modelowi kilka przykładów idealnego wykonania zadania. Każdy przykład zamknij w tagu

<example>. Ta technika jest znacznie skuteczniejsza niż długie, opisowe instrukcje. Zamiast pisać "odpowiadaj krótko i zwięźle", pokaż mu, jak to wygląda w praktyce. -

Format Wyjściowy i Ograniczenia: Jawnie zdefiniuj strukturę odpowiedzi. Jeśli potrzebujesz formatu JSON, określ jego schemat. Wskaż, czego model ma unikać, np.

Nie używaj marketingowego żargonu. Unikaj strony biernej. Nie przekraczaj 200 słów.

Zaawansowane techniki optymalizacji i ręcznego dopracowywania wygenerowanych instrukcji

Nawet najlepiej wygenerowany prompt może wymagać kalibracji. Proces ten, znany jako Prompt Refinement, jest iteracyjny i opiera się na analizie błędów modelu.

Troubleshooting i diagnostyka:

Gdy model zwraca halucynacje lub zbyt ogólne odpowiedzi, przyczyna niemal zawsze leży w niejednoznaczności promptu. Zdiagnozuj problem, zadając sobie pytania: Czy kontekst był wystarczający? Czy w zadaniu jest pole do interpretacji? Rozwiązaniem jest dodanie bardziej rygorystycznych ograniczeń lub dostarczenie kontrprzykładu w sekcji <example>, który pokazuje, jakiego wyniku sobie nie życzysz. Analizując błędy, warto czerpać inspirację z publicznie dostępnych baz, gdzie znajdziesz sprawdzone szablony i przykłady instrukcji dla Claude, demonstrujące skuteczne rozwiązania konkretnych problemów.

Sterowanie formatem za pomocą 'prefill':

Jedną z najpotężniejszych technik wymuszania określonego formatu wyjściowego jest 'prefill', czyli wstępne wypełnienie początku odpowiedzi asystenta. Jeśli model ma problemy z generowaniem poprawnego JSON-a, możesz rozpocząć jego odpowiedź od otwierającej klamry { lub nawet całego klucza {"nazwa_produktu": ". Ta prosta technika znacząco zwiększa prawdopodobieństwo, że model podąży za narzuconą strukturą, oszczędzając cykle walidacji i parsowania wyniku.

Iteracyjne doprecyzowanie:

Traktuj optymalizację promptu jak proces deweloperski.

Krok 1: Generuj. Użyj narzędzia, aby stworzyć bazowy prompt.

Krok 2: Testuj. Uruchom go na reprezentatywnym zestawie danych.

Krok 3: Analizuj. Zidentyfikuj powtarzające się błędy (np. zły format daty, niewłaściwy ton).

Krok 4: Udoskonal. Dodaj precyzyjną instrukcję lub przykład korygujący ten konkretny błąd.

Krok 5: Powtórz.

Zarządzanie wersjami promptów w tym cyklu może być wyzwaniem. Platformy takie jak promptgenerator.pl ułatwiają ten proces, oferując funkcje wersjonowania i testowania A/B, co pozwala na systematyczne i mierzalne ulepszanie instrukcji bez utraty poprzednich, działających wariantów.

Automatyzacja inżynierii promptów: Budowa własnego generatora dla Claude w Pythonie

Przejście od manualnego dopracowywania instrukcji do zautomatyzowanego systemu generowania promptów jest kluczowym krokiem w skalowaniu aplikacji opartych na LLM. Zamiast polegać na statycznych szablonach, budujesz dynamiczny mechanizm, który adaptuje instrukcje w czasie rzeczywistym. Własny skrypt w Pythonie zapewnia pełną kontrolę nad tym procesem, integrację z istniejącą infrastrukturą i możliwość implementacji zaawansowanych technik, takich jak pętle sprzężenia zwrotnego.

Programistyczne podejście do generowania promptów dynamicznych

Podstawą programistycznego generatora jest separacja logiki od treści. Zamiast przechowywać całe prompty jako twardo zakodowane ciągi znaków, wykorzystaj silniki szablonów, takie jak Jinja2. Pozwala to na przygotowanie bazowych struktur promptów z dynamicznie wstrzykiwanymi zmiennymi.

Przykładowy szablon prompt_template.xml.j2 mógłby wyglądać następująco:

<prompt>

<persona>Jesteś ekspertem w dziedzinie {{ domain }} z 15-letnim doświadczeniem.</persona>

<task>Przeanalizuj poniższy kontekst i odpowiedz na pytanie użytkownika. Odpowiedź przedstaw w formacie JSON.</task>

<context>

{{ context_data }}

</context>

<user_query>

{{ user_query }}

</user_query>

</prompt>

W kodzie Pythona renderowanie finalnego promptu sprowadza się do wczytania szablonu i przekazania do niego słownika z danymi. Kluczową zaletą jest dynamiczne zarządzanie kontekstem. W systemach RAG (Retrieval-Augmented Generation) zmienna {{ context_data }} nie jest statyczna. Twój skrypt, przed wygenerowaniem promptu, odpytuje bazę wektorową (np. Pinecone, Weaviate) o fragmenty dokumentacji najbardziej relewantne dla user_query. Zwrócone dane są automatycznie wstrzykiwane do tagu <context>, dostarczając modelowi precyzyjnej, aktualnej wiedzy potrzebnej do udzielenia odpowiedzi.

Zobacz, jak w praktyce wygląda budowa kompletnej aplikacji RAG, która łączy potencjał Claude z zewnętrzną bazą wiedzy, demonstrując dynamiczne składanie promptów w oparciu o dane wejściowe.

Integracja API Anthropic i zarządzanie zmiennymi w promptach

Po wyrenderowaniu kompletnego promptu, kolejnym krokiem jest wysłanie go do API Anthropic za pomocą oficjalnego SDK w Pythonie. prawdziwa automatyzacja wykracza poza proste wywołania API. Kluczowe staje się wdrożenie pętli sprzężenia zwrotnego (feedback loop).

Mechanizm ten polega na programistycznej analizie odpowiedzi modelu. Skrypt może walidować, czy wygenerowany JSON jest zgodny z predefiniowanym schematem, czy odpowiedź nie zawiera fraz z czarnej listy, lub czy jej długość mieści się w założonych ramach. Jeśli walidacja zawiedzie, system może automatycznie wygenerować nowy, skorygowany prompt. Przykładowo, jeśli model pominął wymagane pole w JSON-ie, pętla może dodać do następnego promptu nowy przykład w tagu <example>, który jednoznacznie demonstruje oczekiwaną strukturę.

Zarządzanie tak złożonymi promptami wymaga systematycznego wersjonowania. Zamiast trzymać je w przypadkowych plikach, traktuj je jak kod źródłowy. Wykorzystaj system kontroli wersji, taki jak Git, do śledzenia zmian w plikach szablonów. To umożliwia przeprowadzanie testów A/B. Możesz uruchomić dwie wersje generatora z różnymi wariantami promptu (np. jeden z instrukcją "be concise", a drugi z "be direct") i mierzyć, który z nich osiąga lepsze wskaźniki (np. niższy odsetek błędów walidacji). Programatyczne podejście gwarantuje, że finalna instrukcja jest zawsze poprawna składniowo, co jest fundamentem tworzenia dobrze ustrukturyzowanych zapytań dla Claude i maksymalizacji jego wydajności.

, nie zapominaj o bezpieczeństwie. Każda dana wejściowa od użytkownika, która ma zostać wstrzyknięta do szablonu (np. user_query), musi przejść proces sanityzacji. Zapobiega to atakom typu prompt injection, w których złośliwy użytkownik mógłby spróbować wstrzyknąć do zapytania własne instrukcje, nadpisując Twoją logikę systemową.

Implementacja branżowa: Szablony i dobór modelu do wygenerowanego promptu

Wygenerowanie zoptymalizowanego promptu to dopiero połowa sukcesu. Jego skuteczność zależy od dwóch powiązanych czynników: precyzyjnego dopasowania do zadania branżowego oraz wyboru odpowiedniego modelu obliczeniowego z rodziny Claude. Błędny dobór modelu może zniweczyć potencjał nawet najlepiej skonstruowanej instrukcji, prowadząc do nieoptymalnych wyników, zbyt wysokich kosztów lub nadmiernej latencji. Poniżej przedstawiamy gotowe struktury i matrycę decyzyjną, które pozwolą Ci maksymalizować ROI z automatyzacji inżynierii promptów.

Gotowe szablony promptów dla Claude do zadań programistycznych i analitycznych

Generator promptów powinien operować na sprawdzonych, reużywalnych szablonach, które adaptujesz do specyfiki projektu. Kluczem jest separacja stałych instrukcji od dynamicznie wstrzykiwanych danych.

Case Study 1: IT (Refaktoryzacja Kodu)

Zadaniem jest refaktoryzacja fragmentu kodu Python w celu poprawy czytelności i wydajności. Generator musi stworzyć prompt, który wymusza na modelu logiczne podejście krok po kroku.

Szablon promptu:

<prompt>

<persona>Jesteś starszym inżynierem oprogramowania specjalizującym się w optymalizacji kodu Python i architekturze zgodnej z zasadami SOLID.</persona>

<task>

Przeanalizuj poniższy fragment kodu. Zastosuj metodologię 'Chain of Thought', aby krok po kroku wyjaśnić swój proces.

1. Zidentyfikuj "code smells" i potencjalne wąskie gardła wydajnościowe.

2. Zaproponuj konkretne zmiany refaktoryzacyjne, uzasadniając każdą z nich.

3. Wygeneruj finalną, zoptymalizowaną wersję kodu z komentarzami wyjaśniającymi kluczowe modyfikacje.

</task>

<context>

<language>Python</language>

<framework>FastAPI</framework> <!-- Adaptacja pod żargon branżowy -->

<code>

{{user_code_snippet}}

</code>

</context>

<output_format>Markdown z blokami kodu dla każdego kroku.</output_format>

</prompt>

Taka struktura zmusza model do myślenia procesowego, co jest kluczowe w zadaniach programistycznych i znacząco redukuje ryzyko halucynacji.

Case Study 2: HR (Analiza CV)

Celem jest ekstrakcja ustrukturyzowanych danych z setek CV w formacie PDF. Priorytetem jest precyzja i formatowanie wyjścia, które umożliwi dalszą, automatyczną analizę.

Szablon promptu:

<prompt>

<persona>Jesteś precyzyjnym analitykiem danych HR. Twoim zadaniem jest ekstrakcja informacji z dokumentu CV.</persona>

<task>Przeanalizuj poniższy tekst i wyodrębnij wymagane dane. Zignoruj wszelkie informacje niepasujące do schematu. Jeśli dana informacja nie występuje, zwróć wartość null dla odpowiedniego klucza.</task>

<context>

<document_text>

{{cv_text_content}}

</document_text>

</context>

<output_format>

Odpowiedz wyłącznie w formacie JSON, ściśle przestrzegając poniższego schematu:

<json_schema>

{

"contact": { "email": "string", "phone": "string" },

"experience_years": "integer",

"skills": ["string"],

"last_position": "string"

}

</json_schema>

</output_format>

</prompt>

Wymuszenie formatu JSON z konkretnym schematem jest fundamentalne dla zadań analitycznych, szczególnie przy pracy na dużych zbiorach danych.

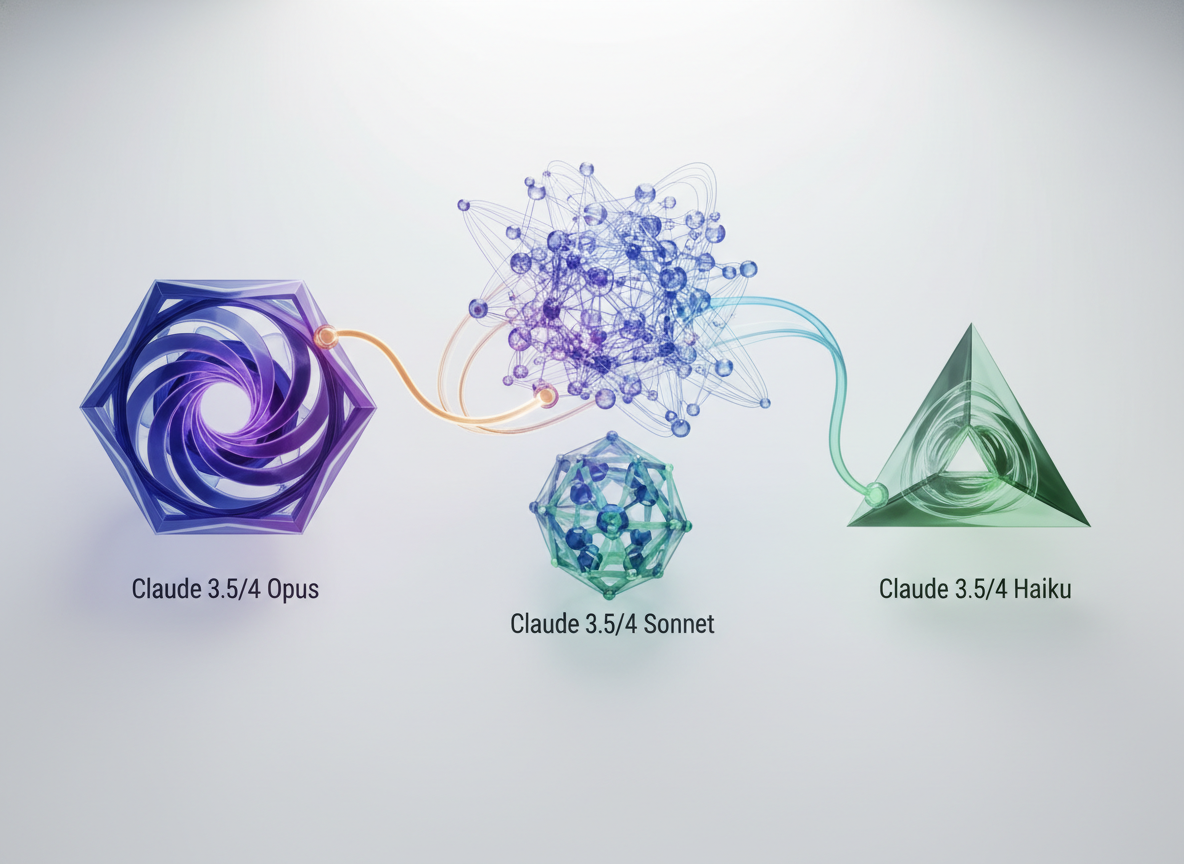

Strategie doboru modelu (Opus, Sonnet, Haiku) do specyfiki wygenerowanego promptu

Złożoność wygenerowanego promptu bezpośrednio determinuje, który model Claude będzie najbardziej efektywny kosztowo i wydajnościowo. Użycie modelu Opus do prostego zadania jest marnotrawstwem zasobów, podczas gdy Haiku zawiedzie przy złożonym rozumowaniu.

Matryca decyzyjna:

Claude 3.5/4 Opus: Wybieraj ten model, gdy prompt wymaga głębokiego, wieloetapowego rozumowania, kreatywności lub analizy złożonych, niejednoznacznych danych. Jest to model pierwszego wyboru dla zadań takich jak refaktoryzacja kodu z wykorzystaniem 'Chain of Thought', przygotowanie strategii marketingowych od zera czy analiza dokumentów prawnych. Jego koszt jest uzasadniony precyzją w zadaniach o wysokim znaczeniu biznesowym.

Claude 3 Sonnet: To zbalansowany model do większości standardowych zadań biznesowych. Jest idealny do promptów, które są dobrze ustrukturyzowane, ale wymagają czegoś więcej niż prostej ekstrakcji danych. Użyj go do generowania treści marketingowych na podstawie briefu (Case Study z marketingu), kategoryzacji opinii klientów czy wspomnianej analizy CV, gdzie schemat wyjściowy jest jasno zdefiniowany. Oferuje najlepszy stosunek wydajności do ceny.

Claude 3 Haiku: Model zoptymalizowany pod kątem szybkości i minimalnego kosztu. Jego domeną są zadania o dużej skali i niskiej złożoności obliczeniowej. Wykorzystaj go do prostych promptów realizujących zadania transakcyjne: ekstrakcja adresów e-mail z tekstu, walidacja formatu danych czy obsługa prostych zapytań w chatbotach w czasie rzeczywistym.

Zrozumienie tej matrycy decyzyjnej jest fundamentalne. Dobrze zaprojektowany system powinien dynamicznie wybierać model na podstawie metadanych zadania lub analizy samego promptu. Więcej na ten temat znajdziesz w naszym kompletnym przewodniku Prompt Generator: Ranking Narzędzi, Meta-Prompting i Optymalizacja. Zaawansowany generator nie tworzy instrukcję, ale także rekomenduje, które narzędzie obliczeniowe najlepiej ją wykona.

Podsumowanie: Kiedy claude prompt generator to za mało?

Automatyzacja inżynierii promptów za pomocą dedykowanych generatorów stanowi fundamentalny krok w kierunku skalowalnej i efektywnej interakcji z modelami językowymi Claude. Jak wykazaliśmy, narzędzia te pozwalają na błyskawiczne przygotowanie ustrukturyzowanych instrukcji w formacie XML, definiowanie ról (persona) i wymuszanie pożądanych formatów wyjściowych. że, poleganie wyłącznie na automatyzacji prowadzi do pułapki, w której tracimy kontrolę nad kluczowymi niuansami decydującymi o sukcesie zadania. Generator to potężne narzędzie wspomagające, a nie autonomiczny ekspert. Jego skuteczność kończy się tam, gdzie zaczyna się potrzeba głębokiej wiedzy domenowej i ludzkiej intuicji.

Ograniczenia i wyzwania związane z używaniem generatorów promptów

Nawet najbardziej zaawansowany generator promptów z 2026 roku napotyka na twarde granice, których przekroczenie wymaga interwencji człowieka. Identyfikacja tych scenariuszy jest kluczowa dla uniknięcia kosztownych błędów i generycznych odpowiedzi.

Pierwszym obszarem jest wysoka kreatywność i niuanse emocjonalne. Zadania takie jak pisanie przemówień, przygotowanie unikalnej tożsamości marki (brand voice) czy generowanie subtelnego humoru wymagają zrozumienia kontekstu kulturowego i emocjonalnego, którego generator nie jest w stanie zakodować w tagach XML. Wygenerowany prompt może stworzyć technicznie poprawną strukturę, ale finalny szlif, nadający treści autentyczność, musi pochodzić od człowieka.

Drugim wyzwaniem jest specyficzna wiedza domenowa. W dziedzinach takich jak prawo, medycyna czy inżynieria kwantowa, skuteczny prompt musi zawierać precyzyjną terminologię i ukryte założenia, które są drugą naturą dla eksperta. Generator może stworzyć ogólny szablon do analizy dokumentacji technicznej, ale nie uwzględni specyfiki konkretnej normy ISO czy protokołu komunikacyjnego, jeśli nie zostanie to jawnie wprowadzone.

Trzecim ryzykiem jest "over-engineering" promptu. W pogoni za precyzją, łatwo jest stworzyć nadmiernie złożoną instrukcję. Czasem proste, jednozdaniowe polecenie skierowane do modelu Haiku przyniesie lepsze i szybsze rezultaty niż wielopoziomowa struktura XML przeznaczona dla Opus. Generator, nie znając pełnego kontekstu biznesowego, może faworyzować złożoność tam, gdzie wymagana jest prostota.

Optymalizacja tokenów i kosztów poprzez precyzyjne generowanie promptów dla Claude

Każdy token w zapytaniu API ma swoją cenę. Źle skonfigurowany generator, tworzący "przegadane" i redundantne prompty, bezpośrednio zwiększa koszty operacyjne. Ekonomia tokenów wymaga znalezienia złotego środka między zwięzłością (conciseness) a jednoznacznością (clarity).

Źle zoptymalizowany prompt charakteryzuje się powtórzeniami i zbędnymi instrukcjami. Przykładem może być generowanie polecenia: <task>Twoim zadaniem jest przeanalizowanie poniższego tekstu. Proszę, abyś zidentyfikował kluczowe punkty i na ich podstawie stworzył zwięzłe podsumowanie w punktach.</task>. Ten sam cel można osiągnąć znacznie oszczędniej: <task>Wygeneruj podsumowanie w formie listy punktowanej dla tekstu w tagu <document>.</task>. Ręczna walidacja i refaktoryzacja wygenerowanego promptu jest więc nie kwestią jakości, ale również kontroli budżetu, zwłaszcza przy operacjach na dużą skalę.

Kompletny proces, od idei do wykonania, powinien zatem wyglądać następująco:

-

Definicja intencji: Precyzyjne określenie celu biznesowego.

-

Użycie generatora: Stworzenie strukturalnego fundamentu (XML, persona, format wyjściowy).

-

Ręczna walidacja i optymalizacja: Usunięcie redundancji, dodanie wiedzy domenowej, dostosowanie tonu.

-

Wybór modelu: Dobór odpowiedniego silnika (Opus, Sonnet, Haiku) na podstawie finalnej złożoności promptu.

Patrząc w przyszłość, modele o zaawansowanych zdolnościach rozumowania (reasoning) mogą zautomatyzować część tego procesu, lepiej interpretując niejednoznaczne intencje. fundamentalna potrzeba precyzyjnego formułowania złożonych instrukcji pozostanie. Rola inżynierii promptów ewoluuje z tworzenia poleceń do projektowania systemów myślowych dla AI, a generatory staną się w tym procesie inteligentnymi partnerami, a nie pasywnymi wykonawcami.

Opanowanie mechaniki meta-promptingu, świadomy dobór narzędzi i modeli oraz zrozumienie, kiedy automatyzacja jest niewystarczająca, to filary skutecznej pracy z Claude w 2026 roku. Ręczna optymalizacja i wiedza ekspercka pozostają kluczowym elementem, który odróżnia wyniki przeciętne od tych generujących realną wartość biznesową.

Jeśli chcesz przyspieszyć proces tworzenia instrukcji i uniknąć typowych pułapek, potrzebujesz narzędzia, które połączy automatyzację z elastycznością. Wypróbuj https://promptgenerator.pl – specjalistyczną platformę, która wspiera przygotowanie, optymalizację i zarządzanie promptami dla modeli takich jak Claude. Dzięki niej błyskawicznie przekształcisz swoje pomysły w precyzyjne instrukcje, podniesiesz jakość odpowiedzi AI i zyskasz kontrolę nad całym procesem komunikacji z modelem.